Страх перед апокалипсисом с участием роботов скрывает реальные проблемы, с которыми мы сталкиваемся, позволяя алгоритмам управлять нашей жизнью. Если верить экспертам в области искусственного интеллекта, мы неуклонно движемся к определенной точке, после которой нам уже не придется ничего изобретать: искусственный интеллект будет сам все делать, а машины будут улучшаться экспоненциально. Если это произойдет, что же станет с нами?

За последние несколько лет многие видные ученые, от Стивена Хокинга до Элона Маска, предупреждали нас, что нам стоит крайне обеспокоиться возможными опасными исходами появления сверхразумного искусственного интеллекта. И они подкрепляют свои слова действиями: Маск покровительствует OpenAI, организации, которая разрабатывает ИИ, который будет приносить пользу человечеству.

Однако многие считают их опасения преувеличенными. Как отмечает Эндрю Ын из Стэнфордского университета, который также является главным научным сотрудником китайского интернет-гиганта Baidu, переживать о восстании машин — это как беспокоиться о перенаселенности Марса.

Но это, конечно, не значит, что наша растущая зависимость от ИИ не несет реальных рисков. На самом деле, эти риски уже здесь. По мере того как интеллектуальные системы принимают все большее участие в разных сферах, от здравоохранения до уголовного правосудия, существует опасность того, что важные части нашей жизни останутся без должного внимания.

Более того, ИИ может привести к неприятным последствиям, если мы не будем к ним готовы, например, изменит наше отношение к врачам на резко неприязненное.

Два слова об искусственном интеллекте

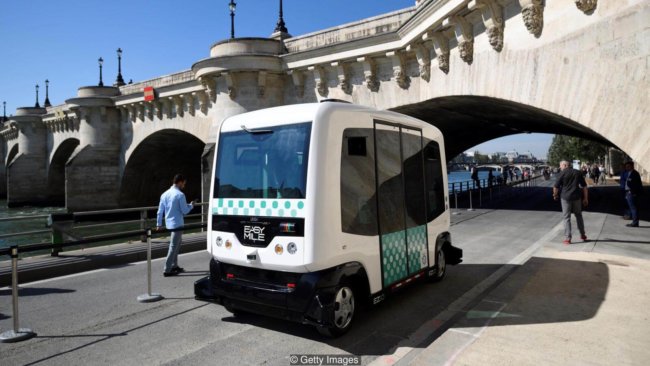

Если простыми словами, это машины, которые делают вещи, которые обычно требуют умственных усилий со стороны человека: понимание естественного языка, распознавание лиц на фотографиях, управление автомобилями и так далее.

Существует разница между механическим манипулятором на производственной линии, который запрограммирован на выполнение одной и той же задачи, и манипулятором, который самостоятельно учится выполнять различные задачи методом проб и ошибок.

Как ИИ помогает нам?

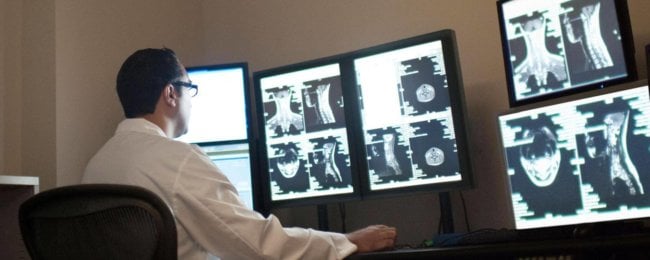

Ведущий подход в ИИ сейчас — это машинное обучение, в ходе которого программы обучаются выявлять определенные паттерны в больших объемах данных, например, идентифицировать лицо на изображении или делать победный ход в настольной игре го. Этот метод можно применить к самым разным проблемам. Например, обучить компьютеры выявлять конкретную картину на медицинских снимках. Компания DeepMind, разрабатывающая искусственный интеллект и принадлежащая Google, разрабатывает программное обеспечение, которое обучается диагностировать рак и заболевания глаз по сканам пациентов. Другие используют машинное обучение, чтобы обнаруживать ранние признаки заболеваний сердца и Альцгеймера.

Искусственный интеллект также уже используется для анализа больших объемов молекулярной информации в поисках потенциальных новых вариантов лекарств — для людей этот процесс занимает чрезвычайно много времени. Очень скоро машинное обучение может стать незаменимым для медицины.

Искусственный интеллект также помогает нам управлять чрезвычайно сложными системами, вроде сети глобальных поставок. Система в самом центре контейнерного терминала Порт Ботани в Сиднее управляет движением десятков тысяч транспортных контейнеров, парком автоматизированных машин и так далее, полностью без людей. В горнодобывающей промышленности системы оптимизации все чаще используются для планирования и координации движения ресурсов, например, железной руды.

ИИ работают везде, куда ни глянь, от финансов до транспорта, управляют самолетами и следят за рынком акций. И защищают от спама вашу почту. Но это только начало. По мере развития ИИ будет становиться все сложнее и интереснее.

В чем же проблема?

Вместо того чтобы беспокоиться о будущем перевороте ИИ, самый большой риск лежит в том, что мы можем слишком сильно довериться интеллектуальным системам, которые строим. Достаточно вспомнить, что машинное обучение тренирует программное обеспечение выявлять паттерны в данных. После обучения оно приступает к анализу свежих, еще не изученных данных. Но когда компьютер выплевывает ответ, мы, как правило, понятия не имеем, как он к нему пришел.

Здесь на лицо очевидные проблемы. Система хороша ровно настолько, насколько хороши данные, по которым она учится. Возьмите систему, обученную определять, у каких пациентов с пневмонией выше шанс умереть, чтобы их пускали в больницу первыми. Допустим, она неосторожно классифицирует больных с бронхиальной астмой как пациентов с низким риском. Потому что в обычной ситуации люди с астмой и пневмонией идут прямо на интенсивную терапию, поэтому получают лечение, которое снижает риск смерти. Машинное обучение видит это как «астма + пневмония = риск смерти ниже».

По мере того как ИИ получают доступ ко всем сферам вашей жизни, повышается и риск того, что что-то пойдет не так — если это не предусмотреть. И поскольку большая часть данных, которые мы скармливаем ИИ, несовершенна, мы не должны ожидать идеальных ответов в большинстве случаев. Мы строим искусственный интеллект по своему образу и подобию; скорее всего, он будет «не очень», как и мы.

Источник: